Tras el video falso viralizado en redes sociales de Sergio Massa, El Destape dialogó con Leonardo Murolo, doctor en Comunicación y especialista en nuevas plataformas y tecnologías, que analizó los efectos de la incorporación de la inteligencia artificial en el mercado de la información en medio de las elecciones 2023.

A menos de una semana del balotaje de las elecciones 2023 entre el candidato de La Libertad Avanza, Javier Milei, y el candidato de Unión por la Patria, Sergio Massa, este último fue blanco de una “campaña sucia” en redes sociales al viralizarse un video falso relacionado al consumo de drogas, hecho con inteligencia artificial.

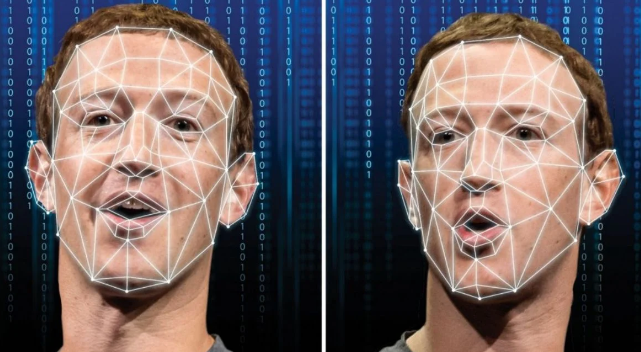

Según explicó a El Destape el doctor en Comunicación y profesor de la Universidad Nacional de Quilmes y de La Plata especializado en nuevas plataformas y tecnologías, Leonardo Murolo, la realización de estos videos llamados “deepfake” puede parecer un “saber sofisticado”. Sin embargo, “cualquier persona con algunos conocimientos básicos de diseño, edición de video y uso de inteligencia artificial podría generar estos contenidos y hacerlos”.

El término deepfake proviene de la combinación de las expresiones “deeplearning” (aprendizaje profundo, en inglés) y “fake” (falso, en inglés), que se convierten en noticias falsas, o también llamadas “fake news”. En el video en cuestión, se ve a un falso Sergio Massa aspirando un polvo blanco que dice “qué rica está la meme”.

Ese mismo video tiene variaciones de edición. Por ejemplo, la cuenta de X @liberaldemilei subió ese video con mayor duración, donde se lo escucha también decir “buen día, grupo”. Se trata de una frase que se usa para contenidos enviados en grupos de WhatsApp, por ejemplo. El usuario, además, llamó a compartir el video con un hashtag específico.Así, entre memes y retuits con videos e imágenes cada vez más editadas, el contenido no tardó en hacerse viral en la red social anteriormente llamada Twitter.

El video original utilizado ya era conocido en Internet. Sólo fue necesario cambiarle el rostro al protagonista del video por el de Sergio Massa, y se le agregó la voz del candidato. Para realizar este tipo de contenidos audiovisuales falsos se utiliza la Deepface (“face”, rostro en inglés) y la Deep Voice (“voice” en inglés), es decir, la modificación de la cara y voz de una persona en un video simulando que es otra. Las Deepfaces se realizan a través del aprendizaje automático de la inteligencia artificial, donde se manipulan y generan nuevas imágenes o videos a partir de otros y se reemplaza a la persona que aparece en ellos. El objetivo es generar diferentes imágenes estáticas para crear una secuencia de vídeo, de modo que, como objetivo final, se obtenga un vídeo falso que parezca 100% real, según información publicada por LISA Institude, dedicada a la enseñanza y estudio de las nuevas tecnologías. En tanto, las Deepvoices suplantan la voz de una persona en un audio, a través de la falsificación de su voz.

Tal como indica el especialista, “para corroborar si una información que nos interesa es real o falsa, en primer lugar, hay que alfabetizarse en el uso de cada medio que habitamos y reconocer las posibilidades de que la información que más indigne o genere odio sea falsa”. “Luego, como formas provisorias para no caer en esos engaños, habría que buscar que la misma información haya aparecido chequeada en otros medios de comunicación tradicionales, que no se trate de una edición con material de archivo, que no se haya desmentido luego de publicada”, aconsejó.

Esto no es nuevo, en 2019 se produjo el primer delito cibernético por medio de la inteligencia artificial. Unos cibercriminales hicieron creer a un ejecutivo que estaba hablando con el CEO de su empresa, utilizando Deep Voices, haciendo que les transfiriese más de 250.000 dólares.

No es la primera vez que se crean videos o fotos falsas de Sergio Massa relacionado con el consumo de drogas. En septiembre, se hizo viral el video en el que se lo veía recibir una supuesta bolsa con cocaína. Pero, de nuevo, era falso: lo que le arrojaron en ese video eran cartas.

Miente, que algo quedará

La célebre frase “Miente, que algo queda”, atribuida comúnmente al escritor y filósofo alemán Johann Wolfgang von Goethe, tiene por objetivo que, aunque una información sea desmentida o refutada, permanezca una idea o duda que quede implantada en la mente de las personas. En este caso, para desprestigiar la imagen del mencionado candidato en época de campaña presidencial.

“Las fake news o desinformación no se tratan de errores o descuidos periodísticos o de otros sectores sociales que las echan a correr, sino que se trata de prácticas deliberadas con la intencionalidad de defender intereses y dañar la imagen pública de una persona, un colectivo social o un acontecimiento histórico”, explicó Murolo. “La desinformación, fake news o como queramos llamarlo, es una herramienta de tecnopolítica muy poderosa” ya que hacen que las audiencias caigan constantemente en noticias falsas, en formato escrito o audiovisual, y aumente la desinformación.

Chequear la información que se consume de los medios de comunicación o de redes sociales es una dificultad para “grandes porciones de la población que no manejan estas herramientas y desconocen sus posibilidades”. En un escenario de sobreinformación y, por consiguiente, con grandes probabilidades de que circule desinformación o información falsa, “puede resultar injusto que las audiencias de medios tengan que chequear en todo momento la información que encuentran”.

Según Murolo, desde allí “se produce algún tipo de deterioro de imagen de la persona atacada, cuando no se desmienta y haya envalentonamiento de detractores quienes, sabiendo que es falsa, la usen para replicarla y distribuirla”. Además, el contenido queda circulando en las redes y se generan desde allí productos derivados como “memes” o “stickers de Whatsapp” que sólo refuerzan una asociación sin sustento e incomprobable como sucedió, por ejemplo, con el diputado nacional Máximo Kirchner, siendo relacionado al ocio y a “la PlayStation”, o la excandidata presidencial Patricia Bullrich, relacionada a consumos de alcohol.

Este tipo de maniobras se da gracias a un contexto donde las audiencias se informan, cada vez en mayor medida, por redes sociales, que permite el formato de “información signado por la brevedad, la instantaneidad y lo efímero”. “Desde allí que un video editado, una imagen con un textual al lado o simplemente un tuit pueden funcionar como noticia”, explicó el entrevistado.

FUENTE EL DESTAPE